Neurona artificial en el concepto de inteligencia artificial. Los códigos binarios en forma de pared hacen de líneas de transmisión de pulsos y/o información en analogía con un microchip. Ktsdesign / Shutterstock

En los últimos años el término inteligencia artificial y todo lo que tiene que ver con ello está adquiriendo un gran protagonismo y sobredimensionamiento. La expresión inteligencia artificial se está utilizando abusivamente y de forma básicamente incorrecta, diariamente, en múltiples ámbitos cotidianos, desde el político al empresarial.

¿Existen realmente máquinas inteligentes, similares a las personas? Si respondemos a esta pregunta con cierto rigor, desde las bases de las ciencias físicas y matemáticas, la respuesta es no. Y muchos científicos conjeturan y argumentan seriamente que probablemente nunca existirán.

Computar no es lo mismo que pensar

A partir de los años 30 y 40 del siglo XX, se desarrollaron las áreas de conocimiento adyacentes a las matemáticas y la física, como la ciencia de la computación, la electrónica, la automática o la propia área de la inteligencia artificial.

En el año 1937 vieron la luz dos publicaciones científicas de enorme importancia: la primera, Sobre los números computables, con una aplicación al Entscheidungsproblem, del matemático Alan Turing, y la segunda, Análisis simbólico de relés y circuitos de conmutación, del matemático e ingeniero electrónico Claude Shannon. Estos trabajos fundaron la forma inicial de crear máquinas electrónicas capaces de computar, manejar información y manipular símbolos mediante programación algorítmica.

Alan Turing diseñó el bombe, un dispositivo empleado por Reino Unido para descodificar los mensajes cifrados por la máquina alemana Enigma durante la Segunda Guerra Mundial.

Sin embargo, la inteligencia artificial, entendida como aquella que pretende replicar capacidades intelectuales similares a las de las personas (llamada inteligencia artificial general o inteligencia artificial fuerte - IAF) no se ha demostrado en absoluto. Esto es: no hay evidencia ni matemática, ni física, ni se conoce la existencia de ningún prototipo equivalente a las capacidades pensantes de un cerebro humano.

Decisión vs. elección

En 1966 el matemático y profesor de Ciencias de la Computación en el Instituto Tecnológico de Massachusetts (MIT) Joseph Weizenbaum creó en su laboratorio un programa llamado ELIZA capaz de realizar procesamiento de lenguaje natural.

Ejemplo de conversación con ELIZA.

Esta sencilla herramienta reconocía palabras clave en las frases del usuario para elegir una frase modelo de su base de datos con la que contestar.

ELIZA era capaz de entablar una conversación con seres humanos simulando a una psicóloga empática. Weizenbaum modeló su estilo de conversación como preguntas abiertas para animar a los pacientes a comunicarse más eficazmente con la terapeuta, y le sorprendió que su programa fuera tomado en serio por muchos usuarios.

A la vista de que gran número de admiradores consideraron el programa como verdadero precursor de las máquinas pensantes, el propio autor se vio obligado a dejar claro que consideraba esta interpretación totalmente errónea e intentó vehementemente corregir en sus intervenciones posteriores estas ideas.

Entre otros muchos escritos, Weizenbaum publicó en 1976 el libro El poder informático y la razón humana: del juicio al cálculo. Con él trataba de explicar al público en general su trabajo y sus consecuencias desde la filosofía de la ciencia, sin incluir turbadoras fórmulas matemáticas en el texto.

En el libro, el autor distingue entre las capacidades de los computadores y el razonamiento humano, y establece una distinción crucial entre decidir y elegir. Lo mismo que en la automática la decisión y control de un proceso industrial se implementa con un circuito o un computador como el controlador programado de dicho proceso, Weizenbaum explica que decidir es una actividad computacional, algo que en última instancia puede programarse y, sin embargo, la elección es el producto del juicio, no del cálculo.

El papel de la mecánica cuántica

En 1989, el físico, matemático y Premio Nobel en el año 2020 Roger Penrose publicó su influyente libro La nueva mente del emperador en el que demuestra que el pensamiento humano no es básicamente algorítmico.

A caballo entre las matemáticas, la filosofía de la ciencia y la física, el texto incorpora tanto demostraciones matemáticas como ilustradas discusiones de los famosos exámenes de inteligencia (como el test de Turing y el experimento de la habitación china). Además, conjetura la posible necesidad de las leyes de la mecánica cuántica para poder explicar correctamente nuestras mentes.

La obra fue devastadora para la tradicional inteligencia artificial fuerte. Inspiró contestaciones de múltiples autores en diversas áreas de conocimiento, pero sus tesis no pudieron ser refutadas convincentemente.

Penrose avanzó aún más en sus ideas con el segundo de sus libros sobre la conciencia humana, publicado en 1994: Las sombras de la mente. En él incluye una propuesta detallada sobre cómo podrían implementarse esos procesos cuánticos en el cerebro.

Las nuevas conjeturas, propuestas por Penrose y el anestesiólogo y psicólogo Stuart Hameroff combinando enfoques de biología molecular, neurociencia, farmacología y teoría de la información cuántica, postulan que la conciencia se origina en el nivel cuántico dentro de las neuronas, en lugar de la visión convencional de que es producto de las conexiones entre neuronas. Se considera que el mecanismo es un proceso cuántico llamado reducción objetiva que está orquestado (Orch OR) por estructuras celulares llamadas microtúbulos (importantes componentes del citoesqueleto de las neuronas). Se propone que la teoría puede responder al difícil problema de la conciencia y proporcionar un mecanismo para el libre albedrío.

A: Un terminal axónico libera neurotransmisores a través de una sinapsis y son recibidos por microtúbulos en la espina dendrítica de una neurona.

B: Estados de conmutación de tubulinas de microtúbulos simulados.

Estas ideas pueden perfectamente ser incorrectas, tal y como el propio Penrose argumenta. Muchos investigadores multidisciplinares en estos campos intentaron refutar parte de estas propuestas, pero actualmente siguen en vigor.

Sin inteligencia artificial a la vista

Desde un punto de vista global, sabemos que se han estudiado múltiples enfoques desde hace décadas para tratar de desarrollar la inteligencia artificial. Las redes neuronales, los sistemas expertos, la lógica fuzzy y en los últimos tiempos el deep learning y el big data han dado lugar a útiles herramientas para resolver problemas con fines específicos.

Estas herramientas pueden ser impresionantes, pero debemos tener muy claro que no nos hemos acercado al desarrollo de la inteligencia artificial general. La llamada inteligencia débil (o inteligencia estrecha) se corresponde con las aplicaciones que hoy tenemos, pero las afirmaciones exageradas sobre sus éxitos dañan la reputación de la inteligencia artificial como ciencia.

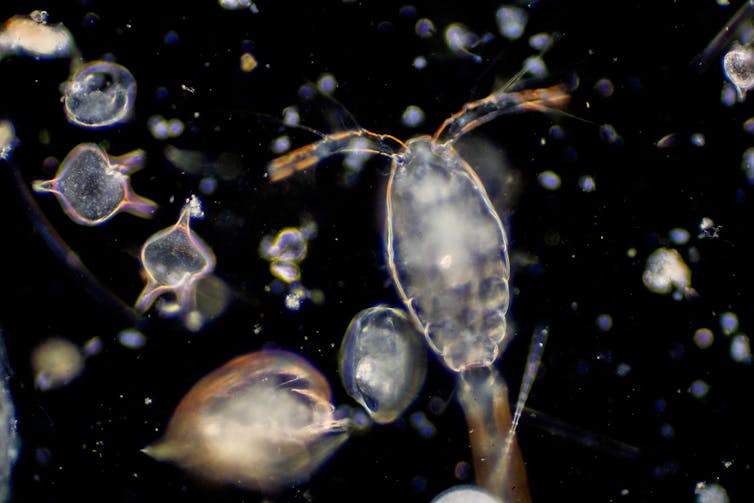

En más de ochenta años de investigación en esta área no se ha producido ninguna prueba firme de desarrollo a niveles humanos de inteligencia artificial general. Sabemos que los circuitos artificiales son incapaces de modelar los sistemas nerviosos incluso de los invertebrados más simples. Aún con computadoras muy rápidas y con enormes bases de datos, confiar en que el razonamiento, la inteligencia y la conciencia surjan de alguna manera simplemente aumentando más y más la complejidad no parece más que un camino sin salida.

Las herramientas informáticas son muy útiles, pero, aunque una máquina gane a los ajedrecistas profesionales o sea capaz de proponer un recurso legal buscando jurisprudencia en su gran base de datos, no es una máquina pensante. Es importante no banalizar, diferenciar entre herramientas tecnológicas y entes inteligentes, así como dejar a la ciencia seguir trabajando con rigor en esta apasionante materia.

Publicado en The Conversation el 16 de agosto de 2022

Autoría:

Victor Etxebarria Ecenarro. Catedrático, Universidad del País Vasco / Euskal Herriko Unibertsitatea.

Cláusula de Divulgación:

Victor Etxebarria Ecenarro recibe fondos de Proyectos de Investigador del MICINN y el Gobierno Vasco.

Ginebra, 31 de agosto de 2022 — Según los datos más recientes de la Organización Meteorológica Mundial (OMM), es probable que el prolongado episodio de La Niña que se está viviendo actualmente persista por lo menos hasta finales de año y, de ese modo, se convierta en el primer "episodio triple" de La Niña de este siglo, al abarcar tres inviernos consecutivos del hemisferio norte (veranos del hemisferio sur).

Tal y como se apunta en el boletín El Niño/La Niña Hoy de la OMM, la probabilidad de que el actual episodio de La Niña continúe durante los próximos seis meses es del 70 % para el período de septiembre a noviembre de 2022, aunque ese porcentaje disminuye gradualmente hasta el 55 % para los meses de diciembre de 2022 a febrero de 2023. Las condiciones que, desde septiembre de 2020, han permitido la instauración de un episodio de La Niña en el Pacífico tropical se han reforzado fruto de la intensificación de los vientos alisios registrada entre mediados de julio y mediados de agosto de 2022. Ello ha incidido en las pautas de temperatura y en la configuración de las precipitaciones y ha exacerbado la sequía y las inundaciones en distintas partes del mundo.

La Niña es un fenómeno que produce un enfriamiento a gran escala de las aguas superficiales de las partes central y oriental del Pacífico ecuatorial, además de otros cambios en la circulación atmosférica tropical, a saber, en los vientos, la presión y las precipitaciones. Por lo general, tiene efectos en el tiempo y el clima opuestos a los de El Niño, que constituye la fase cálida del fenómeno denominado El Niño-Oscilación del Sur (ENOS).

Sin embargo, todos los fenómenos climáticos de origen natural ahora se producen en el contexto del cambio climático antropógeno, que provoca un aumento de las temperaturas mundiales, exacerba los fenómenos meteorológicos y climáticos extremos, y altera la configuración de las temperaturas y las precipitaciones estacionales.

"Es excepcional que un episodio de La Niña se mantenga durante tres años consecutivos. Su efecto de enfriamiento está ralentizando de forma transitoria el aumento de las temperaturas mundiales, pero no detendrá ni invertirá la tendencia al calentamiento a largo plazo", afirmó el Secretario General de la OMM, profesor Petteri Taalas.

"La agudización de la sequía en el Cuerno de África y en la parte meridional de América del Sur lleva el sello de La Niña, al igual que las precipitaciones por encima de la media observadas en el sureste asiático y en Australasia. Desafortunadamente, los datos más recientes sobre La Niña confirman las proyecciones climáticas regionales que apuntaban a un agravamiento de la devastadora sequía que sufre el Cuerno de África, cuyas consecuencias afectarán a millones de personas".

"La OMM seguirá proporcionando información adaptada al sector humanitario y no dejará de brindar apoyo en ámbitos sensibles como los de la agricultura, la seguridad alimentaria, la salud y la reducción de riesgos de desastre. La OMM también trabaja para que todas las personas tengan acceso a los sistemas de alerta temprana en los próximos cinco años a fin de protegerlas de los peligros relacionados con el tiempo, el clima y el agua”, dijo el profesor Taalas.

Proyección del clima estacional mundial

El Niño y La Niña son importantes condicionantes del sistema climático de la Tierra, pero no son los únicos.

Además del boletín El Niño/La Niña Hoy, que la OMM publica desde hace tiempo, la Organización también publica ahora boletines periódicos sobre el clima estacional mundial, en los que se tienen en cuenta las influencias de todos los demás condicionantes climáticos importantes, como la oscilación del Atlántico Norte, la oscilación del Ártico y el dipolo del océano Índico.

Los boletines sobre el clima estacional mundial y El Niño/La Niña Hoy se basan en los pronósticos de los Centros Mundiales de Producción de Predicciones a Largo Plazo de la OMM, y los datos que contienen están a disposición de los gobiernos, las Naciones Unidas, las instancias decisorias y otras partes interesadas de sectores sensibles al clima para que puedan adoptar medidas de preparación y proteger vidas y medios de subsistencia.

A pesar del pertinaz episodio de La Niña en las partes central y oriental del Pacífico ecuatorial, se prevé que en el resto del mundo se impondrán de forma generalizada temperaturas de la superficie del mar superiores a la media que condicionarán el pronóstico de las temperaturas del aire para el período de septiembre a noviembre. Esto contribuirá a que las temperaturas sean superiores a las normales en las zonas terrestres, en particular en gran parte del hemisferio norte.

Por su parte, las precipitaciones previstas son congruentes con los típicos efectos de La Niña relacionados con las lluvias.

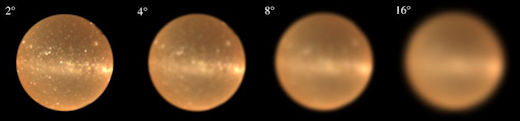

Predicciones probabilísticas de la temperatura del aire en superficie y la precipitación para la temporada de septiembre a octubre de 2022. El período de referencia es el comprendido entre 1993 y 2009.

La Organización Meteorológica Mundial es el portavoz autorizado de las Naciones Unidas sobre el tiempo, el clima y el agua.

Fuente OMM